Warum AI Agents dein neues Compliance-Risiko sind

Die meisten Compliance- und Governance-Modelle in Microsoft 365 basieren auf einer stillschweigenden Annahme: Der Zugriff auf Daten erfolgt durch Menschen. Genau diese Annahme beginnt jedoch zunehmend zu bröckeln. Mit der Einführung von Copilot, SharePoint Agents und weiteren KI-gestützten Funktionen entstehen neue „Akteure“ im System – sogenannte Non-Human Identities. Dieses Thema wird bislang in vielen Organisationen kaum betrachtet, obwohl es tiefgreifende Auswirkungen auf Compliance und Governance hat.

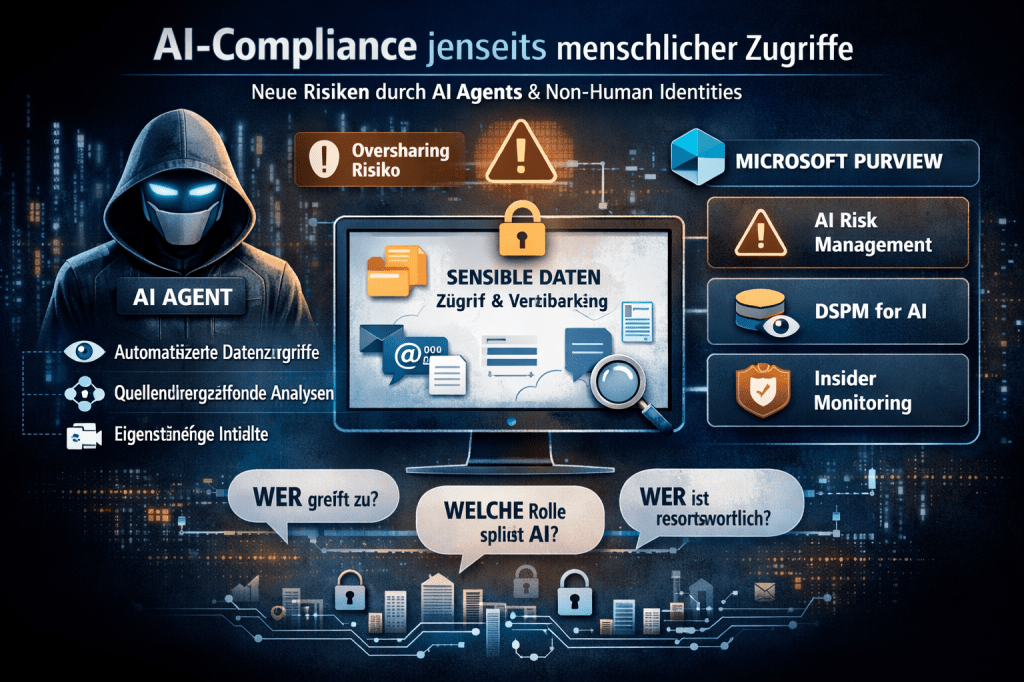

Aus Compliance-Sicht sind AI Agents keine klassischen Benutzerkonten. Sie sind weder reale Personen noch typische Service Accounts, greifen aber dennoch auf Daten zu und verarbeiten diese. Dabei agieren sie im Kontext bestehender Benutzerberechtigungen, jedoch mit völlig anderen Zugriffsmustern. Während menschliche Nutzer meist gezielt auf einzelne Inhalte zugreifen, analysieren AI Agents große Datenmengen in kürzester Zeit, verknüpfen Informationen aus unterschiedlichen Quellen und generieren daraus neue Inhalte. Genau diese Skalierung und Dynamik machen sie so besonders – und gleichzeitig so schwer kontrollierbar.

Das eigentliche Problem liegt weniger im Zugriff selbst, sondern in der fehlenden Transparenz und Nachvollziehbarkeit. Klassische Compliance- und Audit-Mechanismen beantworten Fragen wie: Wer hat auf eine Datei zugegriffen? Wer hat Daten geteilt? Im Kontext von KI verschiebt sich diese Perspektive jedoch grundlegend. Die entscheidende Frage lautet nun: Welche Daten wurden durch einen AI Agent verarbeitet – und in welchem Kontext? Da die Verarbeitung indirekt erfolgt und Ergebnisse oft aus mehreren Quellen zusammengesetzt werden, wird es deutlich schwieriger, Verantwortlichkeiten klar zuzuordnen und Datenflüsse vollständig nachzuvollziehen.

Microsoft reagiert auf diese Entwicklung und erweitert Microsoft Purview schrittweise um entsprechende Funktionen. Dazu gehören unter anderem die Integration von AI-bezogenen Signalen in das Insider Risk Management, erweiterte Audit-Logs für Copilot-Aktivitäten sowie Ansätze im Bereich Data Security Posture Management für KI. Ziel ist es, nicht mehr nur menschliche Aktionen zu überwachen, sondern auch die Rolle von KI bei der Verarbeitung und Nutzung von Daten sichtbar zu machen.

Gleichzeitig zeigt sich immer deutlicher, dass klassische Berechtigungskonzepte allein nicht mehr ausreichen. Lange Zeit galt die Annahme, dass sauber konfigurierte SharePoint- und Teams-Berechtigungen ein ausreichendes Sicherheitsniveau gewährleisten. Diese Sichtweise greift jedoch zu kurz. KI nutzt bestehende Berechtigungen, verstärkt deren Auswirkungen jedoch erheblich. Ein einmal zu großzügig vergebener Zugriff kann dazu führen, dass Inhalte in Zusammenfassungen auftauchen, in neue Dokumente einfließen oder in völlig anderen Kontexten wiederverwendet werden. Oversharing, das bislang oft unterschätzt wurde, entwickelt sich dadurch zu einem deutlich größeren Risiko.

Unternehmen sollten deshalb beginnen, ihre Governance-Strategien neu auszurichten. Im ersten Schritt bedeutet das, Berechtigungen nicht mehr isoliert zu betrachten, sondern immer auch im Kontext von KI-Nutzung zu bewerten. Es reicht nicht mehr zu wissen, wer Zugriff auf Daten hat – entscheidend ist, was mit diesen Daten geschieht, wenn KI darauf zugreift. Darüber hinaus sollte der Fokus stärker auf die Daten selbst gelegt werden, anstatt ausschließlich auf Container wie Sites oder Teams. Sensitivity Labels, Klassifizierungen und datenbasierte Schutzmechanismen gewinnen dadurch weiter an Bedeutung.

Auch im Bereich Monitoring und Audit sind Anpassungen notwendig. Organisationen sollten gezielt analysieren, wie Copilot und andere AI-basierte Funktionen genutzt werden, und die entsprechenden Protokolle in Microsoft Purview aktiv auswerten. Gleichzeitig wird deutlich, dass das Thema nicht ausschließlich in der IT verortet werden kann. Compliance, Datenschutz und Informationssicherheit müssen enger zusammenarbeiten, um die neuen Herausforderungen ganzheitlich zu adressieren.

Letztlich verändert KI nicht nur die Art und Weise, wie wir arbeiten, sondern auch unser grundlegendes Verständnis von Zugriff und Verantwortung. Die zentrale Herausforderung liegt dabei weniger in der Technologie selbst als in der Anpassung bestehender Denkmodelle. Compliance muss lernen, mit nicht-menschlichen Akteuren umzugehen und deren Einfluss auf Datenflüsse zu berücksichtigen.

Die entscheidende Frage ist daher nicht mehr nur, wer Zugriff auf Daten hat, sondern wie viele digitale Instanzen diesen Zugriff bereits nutzen – und was sie damit tun.

DSPM for AI: https://learn.microsoft.com/en-us/purview/dspm-for-ai?utm_source=chatgpt.com

https://learn.microsoft.com/en-us/purview/ai-microsoft-purview?utm_source=chatgpt.com

Copilot-Aktivitäten in Audit Logs integrieren inkl. Zugriff auf Dateien & Interaktionen, Agent-Interaktionen Logging:

DLP Events bei AI Interaktionen:

Hinterlasse einen Kommentar